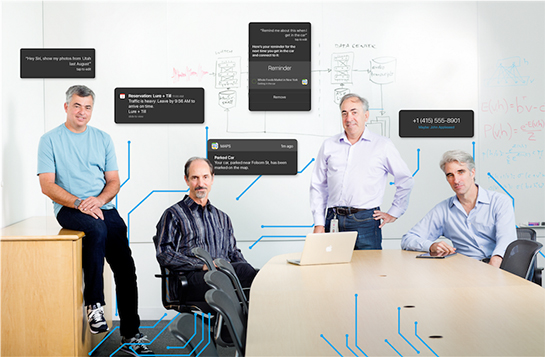

Egy nagyobb interjú készült mindenféle Apple fejessel, egyebek közt Craig Federighi, Eddy Cue, Phil Schiller, és két Siri expert válaszolt az újságíró kérdéseire.

A célkeresztben természetesen a Siri állt és a mögötte található mesterséges intelligencia, ami az elhangzottak alapján hihetetlenül sokat fejlődött 2014. óta. Olyan sokat, hogy Cue szerint a mérési eredményeket újra és újra ellenőrizni kellett, mert először azt hitték, valaki elnézett valamit az ellenőrzés közben egy tizedesjeggyel.

A hihetetlen fejlődés mögött az Apple spéci öntanuló algoritmusa áll, ami folyamatosan gyűjti és értelmezi az adatokat, hogy a végén az iPhone jobban, okosabban szolgáljon ki minket.

De az egész nemcsak a szoftverről szól: Federighi elmondta, hogy sok múlik azon is, hogy a mikrofonokból hányat, hova és hogyan építenek be a telefonba, ami nagy előny az Apple-nél, sokkal egyszerűbb dolguk van az iPhone-iOS-Siri-kombóval, mintha csak egy szoftverük lenne és ki lennének szolgáltatva a telefongyártóknak.

És a mesterséges intelligencia keményen dolgozik a háttérben: ott van, amikor egy ismeretlen telefonszámról érkező hívás mellé feldobja a hívó lehetséges nevét az emailfolyamból, amikor felvillan egy értesítés egy találkozóról, amit sosem mentettünk el, vagy amikor a térképen megjelenik a szállodánk helyszíne és időpontja, pedig csak emailben került elő eddig a hely neve.

Tegyük hozzá, hogy ezeket az adatokat Google is legalább ilyen okosan kitúrja a leveleinkből, a nagy különbség az, hogy az összegyűjtött infókat az Apple jórészt abban a kábé kétszáz megabájtos fájlban tárolja, ami a telefonunkon van és nem küldi el a központi szerverre. Szóval kevésbé vagyunk kiszolgáltatva bárkinek, ami elég fontos szemléletbeli eltérés.

A bejegyzés trackback címe:

Kommentek:

A hozzászólások a vonatkozó jogszabályok értelmében felhasználói tartalomnak minősülnek, értük a szolgáltatás technikai üzemeltetője semmilyen felelősséget nem vállal, azokat nem ellenőrzi. Kifogás esetén forduljon a blog szerkesztőjéhez. Részletek a Felhasználási feltételekben és az adatvédelmi tájékoztatóban.